2026년 4월 2일, Google DeepMind가 Gemma 시리즈의 최신작인 Gemma 4를 공개했습니다. Gemini 3와 동일한 연구 기술 기반으로 만들어진 이 모델 패밀리는, Apache 2.0 라이선스로 배포되어 상업적 활용에 제한이 없습니다. Google에 따르면 Gemma 시리즈는 지금까지 누적 4억 회 이상 다운로드되었으며, 10만 개 이상의 파생 모델이 존재하는 Gemmaverse를 형성하고 있습니다.

특히 이번 Gemma 4는 역대 공개된 오픈 모델 중 최상위 프론티어 모델(Frontier Models)들과 가장 근접한 벤치마크 점수를 기록하며 엄청난 화제를 모으고 있습니다. 31B 모델이 Claude-sonnet-4.5에 근접한 것이죠.

그럼 이 글에서는 Gemma 4의 모델 라인업과 아키텍처 특징을 살펴보고, 주요 모델들과의 벤치마크 비교 결과를 정리합니다. 또한, 이론적인 수치를 넘어 실제 NVIDIA H100 환경에서 vLLM을 이용해 gemma-4-31B-it 모델의 서빙 성능을 측정한 결과도 함께 공유합니다.

1. 모델 라인업

Gemma 4는 총 4가지 크기로 출시되었으며, 각 사이즈별로 프리트레인(base)과 인스트럭션 튜닝(it) 체크포인트가 모두 제공됩니다.

Dense 모델

| 항목 | E2B | E4B | 31B Dense |

| 파라미터 | 2.3B effective (임베딩 포함 5.1B) | 4.5B effective (임베딩 포함 8B) | 30.7B |

| 레이어 수 | 35 | 42 | 60 |

| 슬라이딩 윈도우 | 512 tokens | 512 tokens | 1024 tokens |

| 컨텍스트 길이 | 128K | 128K | 256K |

| 어휘 크기 | 262K | 262K | 262K |

| 지원 모달리티 | 텍스트, 이미지, 오디오 | 텍스트, 이미지, 오디오 | 텍스트, 이미지 |

| 비전 인코더 | ~150M | ~150M | ~550M |

| 오디오 인코더 | ~300M | ~300M | 없음 |

MoE 모델

| 항목 | 26B A4B MoE |

| 총 파라미터 | 25.2B |

| 활성 파라미터 | 3.8B |

| 레이어 수 | 30 |

| 슬라이딩 윈도우 | 1024 tokens |

| 컨텍스트 길이 | 256K |

| 전문가 구성 | 128개 전문가 중 8개 활성 + 1개 공유 |

| 지원 모달리티 | 텍스트, 이미지 |

- "E"는 "Effective"의 약자로, PLE(Per-Layer Embeddings)를 사용하는 소형 모델에서 임베딩 테이블 자체는 크지만 추론 시 실제 연산에 관여하는 파라미터가 훨씬 적다는 점을 반영한 표기입니다.

- "A4B"는 총 26B 파라미터 중 추론 시 4B만 활성화된다는 의미입니다. MoE 모델은 실질적으로 4B급 모델과 비슷한 속도로 동작하면서도 26B 전체 파라미터의 지식을 활용할 수 있어, 레이턴시 중시 워크로드에 적합합니다.

2. 아키텍처 주요 특징

Gemma 4는 이전 세대의 검증된 기법들을 조합하되 불확실한 기법은 배제하여, 다양한 라이브러리와 디바이스에서 호환성을 확보하는 방향으로 설계되었습니다.

- 하이브리드 어텐션 구조: 로컬 슬라이딩 윈도우 어텐션과 글로벌 풀 컨텍스트 어텐션 레이어를 교대로 배치합니다. 마지막 레이어는 반드시 글로벌 어텐션이 됩니다.

- Dual RoPE: 슬라이딩 윈도우 레이어에는 표준 RoPE를, 글로벌 레이어에는 Proportional RoPE(p-RoPE)를 적용하여 긴 컨텍스트를 안정적으로 처리합니다.

- Per-Layer Embeddings (PLE): 일반 트랜스포머와 달리 각 디코더 레이어마다 별도의 저차원 임베딩 벡터를 생성하여 주입합니다. 메인 히든 사이즈보다 훨씬 작은 차원을 사용하기 때문에 파라미터 오버헤드가 적고, 레이어별로 특화된 정보를 효율적으로 전달합니다.

- Shared KV Cache: 모델의 마지막 N개 레이어는 자체 Key/Value 프로젝션을 수행하지 않고, 앞선 레이어에서 계산된 K/V 텐서를 재사용합니다. 품질 영향은 최소화하면서 메모리와 연산량을 절감합니다.

- 비전 인코더: 가변 토큰 버짓(70~1120 토큰)을 지원하여 원본 종횡비를 유지합니다. 낮은 버짓은 분류에, 높은 버짓은 OCR이나 문서 파싱에 적합합니다.

- 오디오 인코더: USM 스타일의 Conformer 아키텍처로, E2B와 E4B 모델에서만 사용 가능하며 최대 30초 오디오를 처리합니다.

3. 주요 기능

Gemma 4가 기존 세대 대비 크게 강화된 부분은 다음과 같습니다.

- 추론(Reasoning): 모든 모델에 built-in thinking) 모드가 탑재되었습니다. <|think|> 토큰을 사용하면 단계적 사고 과정을 거칩니다. AIME 2026에서 31B 모델이 89.2%를 기록해 기존 27B 대비 비약적으로 향상되었습니다.

- 에이전틱 워크플로: 함수 호출(Function Calling), 구조화된 JSON 출력, 네이티브 시스템 프롬프트를 지원하여 자율 에이전트 구축이 가능합니다.

- 코드 생성: LiveCodeBench v6에서 31B 모델이 80.0%를 기록해 로컬 코드 어시스턴트로 손색없는 수준을 보여줍니다.

- 비전 및 오디오: 전 모델이 이미지와 비디오(가변 해상도/종횡비)를 처리하며, 소형 E2B/E4B 모델은 음성 인식과 번역도 지원합니다.

- 긴 컨텍스트: 소형 모델 128K, 대형 모델 256K 토큰을 지원합니다. 128K Needle In A Haystack 테스트에서 31B 모델이 66.4%를 기록하며 크게 개선되었습니다.

- 다국어: 140개 이상의 언어로 사전 학습되었고, 35개 이상 언어에서 즉시 사용 가능한 성능을 제공합니다.

4. 벤치마크 결과

| 벤치마크 | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B |

| MMLU Pro | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026 (no tools) | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| LiveCodeBench v6 | 80.0% | 77.1% | 52.0% | 44.0% | 29.1% |

| Codeforces ELO | 2150 | 1718 | 940 | 633 | 110 |

| GPQA Diamond | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| HLE (no tools) | 19.5% | 8.7% | — | — | — |

| HLE (with search) | 26.5% | 17.2% | — | — | — |

| BigBench Extra Hard | 74.4% | 64.8% | 33.1% | 21.9% | 19.3% |

| MMMLU | 88.4% | 86.3% | 76.6% | 67.4% | 70.7% |

| [비전] MMMU Pro | 76.9% | 73.8% | 52.6% | 44.2% | 49.7% |

| [비전] MATH-Vision | 85.6% | 82.4% | 59.5% | 52.4% | 46.0% |

| [롱 컨텍스트] 8-needle 128K | 66.4% | 44.1% | 25.4% | 19.1% | 13.5% |

Arena AI 텍스트 리더보드 기준으로 31B 모델은 오픈 모델 중 세계 3위, 26B MoE 모델은 6위에 랭크되어 20배 큰 모델들을 상회하는 성능을 보여줍니다. 추정 LMArena 점수는 31B Dense가 1452, 26B MoE가 활성 파라미터 4B임에도 1441을 기록했습니다.

특히 주목할 만한 점은, Gemma 4가 역대 공개된 오픈 모델 중 클로즈드 소스 기반의 최상위 프론티어 모델들과 점수 격차가 가장 근접한 모델이라는 점입니다. 이제 오픈 소스 진영에서도 그리고 로컬에서 일반인이 돌릴 수 있는 크기로 막대한 비용이 투입된 상용 프론티어 모델과 유사하게라도 사용할 수 있다는 희망이 생겼...습니다.

H100 + vLLM 서빙 벤치마크 (gemma-4-31B-it)

이론적인 수치 외에 실제 서빙 환경에서의 성능을 파악하기 위해, NVIDIA H100 80GB tp=2, gpu utill 0.95로 하여 vLLM을 사용하여 온라인 서빙 성능을 측정했습니다.

테스트 조건

| 항목 | 값 |

| GPU | NVIDIA H100 80GB × 2 / gpu_utill 0.95 |

| 추론 엔진 | vLLM |

| 모델 | google/gemma-4-31B-it (bfloat16) |

| 입출력 토큰 | 입력 7,000 / 출력 500 (고정) |

| 동시 요청 수 | 16 (모든 요청 동시 전송) |

결과 및 분석

| 지표 | 값 |

| 벤치마크 소요 시간 | 26.89초 |

| 출력 토큰 처리량 (tok/s) | 297.46 (피크: 456.00) |

| 전체 토큰 처리량 (tok/s) | 4,461.93 |

| TTFT (첫 토큰 생성 시간) | Mean: 10,163ms / Median: 9,427ms / P99: 18,086ms |

| TPOT (토큰 간 생성 시간) | Mean: 20.62ms / Median: 20.96ms / P99: 25.66ms |

- VRAM 효율성: 31B Dense 모델이 bfloat16 그대로 H100 단일 카드에 올라갑니다. 약 62GB의 VRAM을 차지하므로 80GB H100 한 장에 충분히 수용됩니다. (KV Cache 공간과 Context도 고려하면 널널하게 잡으셔야 좋습니다.)

- 처리량(Throughput): 입력 길이 7,000 토큰의 요청 16개를 동시에 전송하는 고부하 조건에서 출력 토큰 처리량은 약 297 tok/s를 기록했습니다.

- 레이턴시(Latency): TTFT는 16개 요청이 동시에 프리필을 경쟁하여 평균 10초 내외가 나왔으나, 사용자 체감 속도를 좌우하는 TPOT(토큰 간 생성 시간)는 평균 20.62ms를 기록했습니다. 이는 초당 약 48 토큰을 받아볼 수 있는 속도로, 실시간 채팅이나 스트리밍 응답에 충분히 쾌적한 수준입니다.

- 대안: 더 낮은 레이턴시가 필요하다면, 활성 파라미터가 3.8B에 불과한 26B A4B MoE 모델을 통해 훨씬 빠른 토큰 생성 속도를 기대할 수 있습니다.

- 대안 2: 8비트 양자화를 통해 H100 hopper 아키텍처에서 가속 또는 4비트 양자화를 진행.

5. 에코시스템 및 사용 방법

Gemma 4는 출시 당일(Day-1)부터 주요 오픈소스 추론 엔진과 도구를 폭넓게 지원합니다.

- 추론: Hugging Face Transformers, vLLM, llama.cpp, Ollama, MLX, SGLang 등

- 파인튜닝: TRL, Unsloth, Google Colab, Vertex AI 등 (TRL은 멀티모달 도구 응답 학습 지원)

- 모바일: 차세대 Gemini Nano 4의 베이스 모델로, Android Studio의 Agent Mode 및 AICore를 통해 디바이스 온디맨드 에이전틱 플로우 구축 가능

6. 라이선스

Gemma 4는 Apache 2.0 라이선스로 배포됩니다. 기존 자체 이용 약관에서 완전한 오픈소스 라이선스로 전환하여, 상업적 배포, 수정, 재배포에 대한 법적 장벽이 사실상 제거되었습니다.

마무리

Gemma 4는 "파라미터당 지능(intelligence-per-parameter)"이라는 표현에 걸맞은 결과를 보여줍니다. 31B Dense 모델은 H100 단일 카드로 서빙이 가능하면서도 세계 최고 수준의 성능을 내고, 26B MoE는 4B급 속도로 동급 품질을 달성합니다.

무엇보다 오픈 모델 중 최상위 프론티어 모델의 성능에 가장 근접했다는 점은 이 모델의 가장 큰 의의입니다. 완전한 Apache 2.0 라이선스, 네이티브 함수 호출, 256K 컨텍스트, 폭넓은 에코시스템 지원까지 갖춘 Gemma 4는 로컬 LLM 생태계의 새로운 기준이 될 것입니다.

그냥...

전 AI Agent 프레임워크과 로컬 LLM 그리고 메신저와 연동해서 사용중인데, 로컬 LLM 한국어 및 전반적인 성능에 대해 살짝 리뷰를 작성하겠습니다. (특정 지표가 아니고 그냥 개인적인 평가입니다.)

요즘 클로드 opus 증류로 huggingface에서 핫했던

Jackrong/Qwen3.5-27B-Claude-4.6-Opus-Reasoning-Distilled 모델

- 한국어 지시 이해 및 출력 성능이 떨어졌습니다.

mistralai/Mistral-Small-4-119B-2603-NVFP4 모델

- 한국어 지시 이해 능력 및 출력 성능이 Qwen3.5보다 좋습니다. 그러나, 여전히 가끔 외국어가 섞여 나오기도 하고 문제를 풀 때 헤매는 경향이 있습니다.

google/gemma-4-31B-it

- 한국어 지시 이해 능력 및 출력 성능이 앞 두 모델에 비해 압도적으로 좋습니다. 아직까지 테스트하면서 외국어도 보지 못했고, 혼자서 스킬 파일도 잘 작성합니다.

----------------------------------------------

gemma-4-31B-it >> Mistral-Small-4-119B-2603-NVFP4 >>> Qwen3.5-27B-Claude-4.6-Opus-Reasoning-Distilled

----------------------------------------------

체감 상 AI Agent로 활용하기 좋은 모델은 위와 같이 비교할 수 있겠네요. 그럼 길게는 안하고 마치겠습니다.

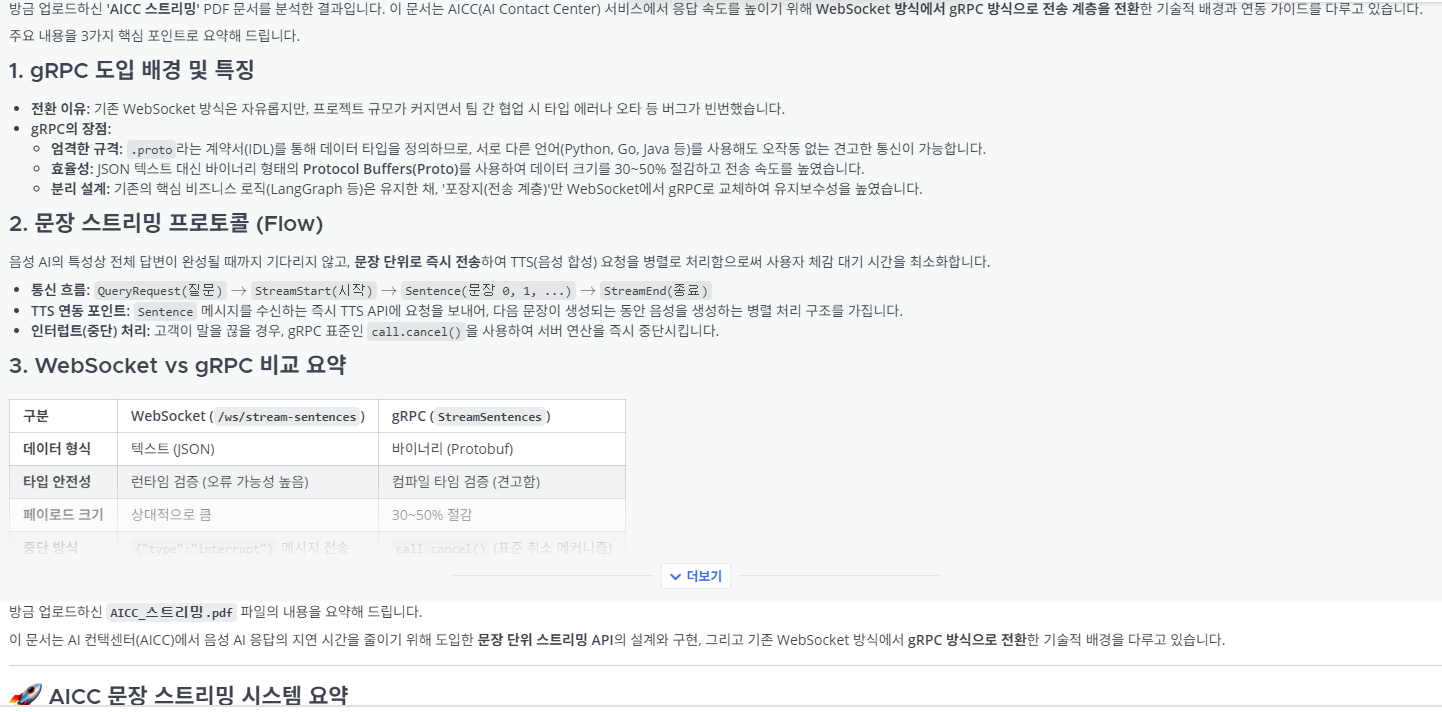

아래는 로컬 AI Agent 프레임워크 + 로컬 LLM + 메신저 조합으로 PDF를 전달하고 요약해달라고 한 결과입니다.

진짜 떠나 볼게요.

혹시 vLLM으로 서빙하려는 분이 있을실거같아서 공유드립니다.

https://mz-moonzoo.tistory.com/145

[LLM] 로컬 vLLM Gemma 4 서빙 팁 (feat. Docker 기반 세팅 가이드)

Gemma 4가 성능이 좋다고 입소문 타면서 개인적으로 문의해주시는 분들이 많으시더라고요. 그래서 간단하게 vLLM과 도커로 Gemma4 서빙하는 방법 알려드리고자 왔습니다.1. 왜 vLLM v0.19.0이어야 하는

mz-moonzoo.tistory.com

'DL > LLM' 카테고리의 다른 글

| [LLM] 로컬 vLLM Gemma 4 서빙 팁 (feat. Docker 기반 세팅 가이드) (2) | 2026.04.08 |

|---|---|

| [LLM] 프롬프트 엔지니어링: NotebookLM을 활용한 실전팁 (feat. 구글 프롬프트 가이드 등) (2) | 2026.02.06 |

| [LLM] RTX 6000 Blackwell vs. H100/H200: 단일/TP 환경별 추론 및 학습 성능 심층 비교 (4) | 2026.01.31 |

| [LLM] Ministral 3 논문 리뷰 (Cascade Distillation) (1) | 2026.01.14 |

| [LLM] 업스테이지 Solar-Open-100B 모델 GLM-4.5-Air 표절 의혹, 공개 검증 세션 핵심 요약 정리 (0) | 2026.01.02 |